Ex-advogado de Trump culpa I.A. por citações falsas em documentos legais

Michael Cohen admitiu ter pensado que o ChatBOT de I.A. da Google, Bard, era “um motor de buscas super alimentado” mais preciso do que outros serviços de I.A. generativa.

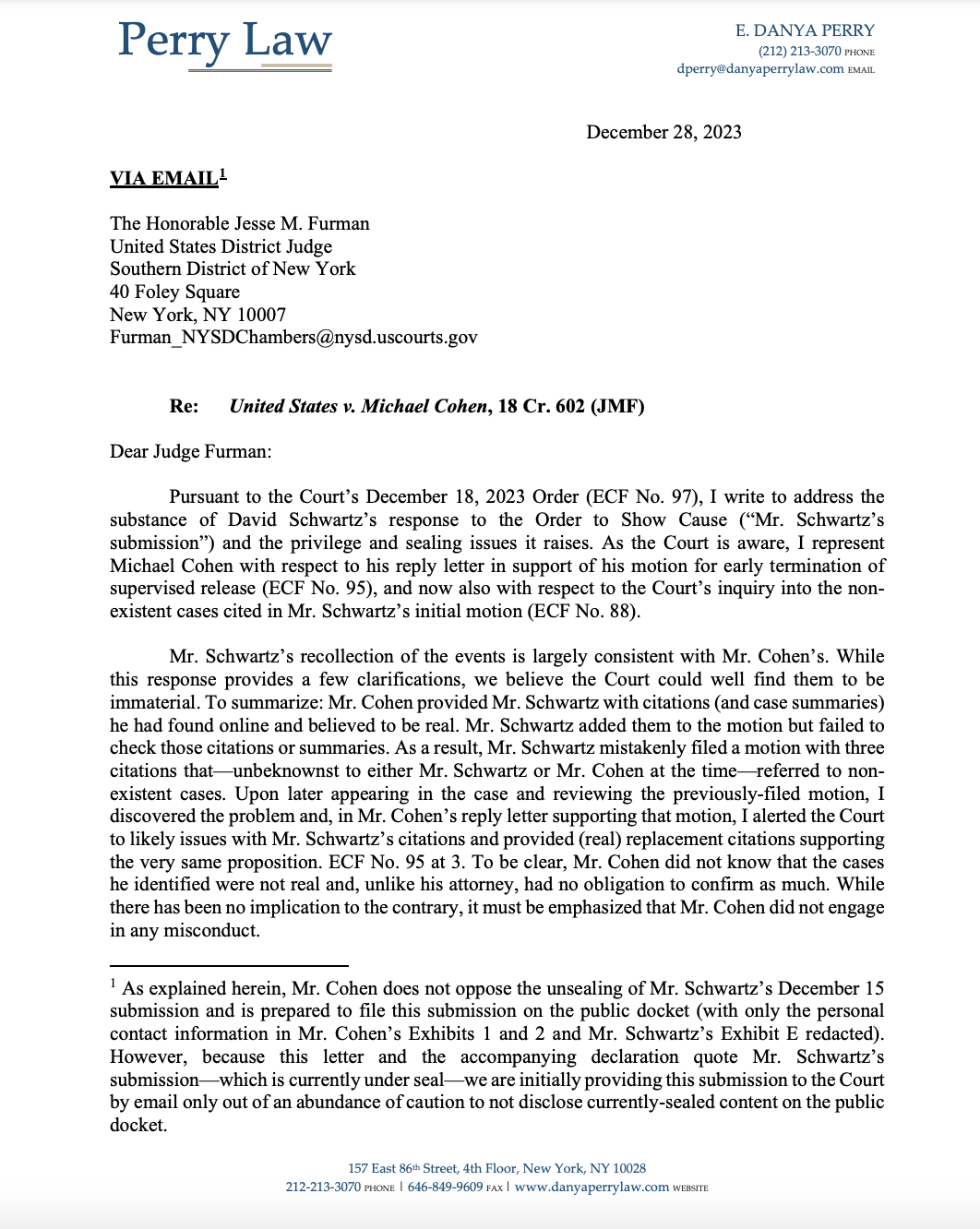

Michael Cohen, ex-advogado de Donald Trump, confessou ter dado por engano ao seu advogado citações incorretas de casos criados pelo ChatBOT de inteligência artificial (I.A.) Google Bard.

Num processo judicial recente, Michael Cohen, que deverá ser testemunha contra Trump nos seus próximos julgamentos criminais, admitiu ter enviado citações legais geradas pelo Google Bard ao seu advogado, David Schwartz, para apoiar o seu caso.

As citações inválidas em questão – e muitas outras que o Sr. Cohen encontrou, mas não foram usadas na moção – foram produzidas pelo Google Bard, que o Sr. Cohen entendeu erroneamente como um mecanismo de pesquisa superalimentado, não um serviço de I.A. generativo, como o Chat-GPT.

No entanto, foi argumentado que Cohen não é um profissional jurídico ativo, e que estava apenas passando informações ao seu advogado, sugerindo que a informação deveria ter sido revista, antes de ser incluída nos documentos oficiais do tribunal.

- Veja também: Os desenvolvedores da Terra Classic começarão o ano de 2024 com toda a energia, focando intensamente nas atualizações

O Sr. Cohen não é um advogado na ativa e não tem noção dos riscos da utilização de serviços de I.A. para pesquisa jurídica, nem tem a obrigação ética de verificar a exatidão da sua pesquisa, afirmava ainda o comunicado, reiterando que era necessária uma revisão adicional:

Para resumir: O Sr. Cohen forneceu ao Sr. Schwartz citações (e resumos de casos) que tinha encontrado online e que acreditava serem reais. O Sr. Schwartz acrescentou-os à moção, mas não verificou essas citações ou resumos.

Este não é o primeiro caso de um advogado sendo exposto por confiar em I.A., apenas para perceber que gerou resultados imprecisos.

No início deste ano, Cointelegraph relatou que Steven Schwartz, um advogado do escritório de advocacia de Nova York Levidow, Levidow & Oberman, enfrentou críticas por usar I.A. na criação do que acabaram sendo comprovadamente, citações judiciais falsas.

Apesar de Schwartz ter afirmado que era a primeira vez que utilizava o ChatGPT para investigação jurídica, o juiz criticou-o fortemente pelas incorrecções:

Seis dos casos apresentados parecem ser decisões judiciais falsas, com citações falsas e citações internas falsas, afirmou o juiz.

Até inteligência artificial pode suprir a preguiça humana?

Traduzido de: Cointelegraph.

Escritor, Compositor e Poeta, não necessariamente nesta ordem. Fissurado em Sci-fi e SteamPunk. Estudando e conhecendo as fascinantes redes Blockchain.